El Protocolo de Contexto de Modelo (MCP, por sus siglas en inglés) es un marco de trabajo de código abierto y un estándar abierto que representa una evolución significativa en la integración de la inteligencia artificial. Introducido por Anthropic a finales de 2024, este protocolo tiene como objetivo principal estandarizar la forma en que los Grandes Modelos de Lenguaje (LLMs) y los agentes de IA interactúan con el mundo exterior. A diferencia de las integraciones de API ad-hoc, que a menudo son lentas y complejas de gestionar, el MCP actúa como una interfaz universal, facilitando que la IA acceda dinámicamente a herramientas, bases de datos y APIs en tiempo real.

El impacto de este protocolo es dual y profundo. Para el campo de la inteligencia artificial, el MCP es un catalizador para la funcionalidad agéntica. Permite a los agentes de IA superar las limitaciones de sus datos de entrenamiento, otorgándoles la capacidad de tomar acciones autónomas, acceder a información actualizada y mantener un estado de sesión persistente a lo largo del tiempo. Para los desarrolladores de sistemas y, en particular, para los ingenieros de backend, el MCP estandariza un proceso de integración que antes era fragmentado, lo que resulta en una reducción tangible de la sobrecarga de desarrollo y mantenimiento, con estimaciones que indican una mejora de hasta el 30% en la eficiencia.

La implementación práctica del MCP, como se demuestra en un caso de uso con Python, valida la promesa de eficiencia del protocolo. Al abstraer la complejidad del protocolo y permitir a los desarrolladores exponer funcionalidades personalizadas con un esfuerzo mínimo, se fomenta una adopción más amplia y la creación de un ecosistema más robusto de herramientas para la IA.

1. Introducción al Protocolo de Contexto de Modelo (MCP)

1.1. Definición y Propósito Fundamental

El MCP es un marco de código abierto introducido en noviembre de 2024 para estandarizar la forma en que los sistemas de inteligencia artificial (IA), como los Grandes Modelos de Lenguaje (LLMs), integran y comparten datos con herramientas, sistemas y fuentes de datos externas. Su propósito fundamental es permitir que los LLMs interactúen dinámicamente con estas fuentes externas a través de una interfaz normalizada y consistente.

Una analogía popular describe el MCP como un «adaptador universal» o un «puerto USB-C para las aplicaciones de IA». Esta comparación resalta su capacidad para facilitar la interoperabilidad, eliminando la necesidad de crear y mantener conexiones únicas para cada nueva aplicación o fuente de datos, lo cual es un proceso notoriamente lento y complicado. El verdadero valor del MCP no se limita a la simplificación de la conectividad; más bien, representa un cambio de paradigma fundamental en la funcionalidad de los LLMs. Antes del MCP, un LLM estaba inherentemente limitado por su corpus de entrenamiento y cualquier interacción con datos externos requería una programación específica y rígida. Con el MCP, el LLM puede, de manera efectiva, «aprender» a utilizar nuevas herramientas y funciones que residen en servidores externos, extendiendo así su capacidad más allá de la mera generación de texto a la ejecución de tareas en el mundo real. Esto transforma un LLM de un simple generador de contenido a un motor de ejecución de tareas con capacidades dinámicas y funcionales.

La necesidad de este protocolo se deriva de una limitación inherente en los modelos de interacción tradicionales. Las peticiones HTTP, por ejemplo, son típicamente «sin estado», lo que significa que el contexto completo de una solicitud (como el historial de una conversación o los detalles de un usuario) debe ser reenviado en cada interacción. El MCP aborda esto al centrarse en la gestión de un «contexto compartido y evolutivo» a lo largo de las interacciones. Al estandarizar el «acuerdo de protocolo» inicial (Initiation) y la gestión del estado de la sesión, el MCP elimina la necesidad de un pre-procesamiento costoso y la retransmisión de grandes cantidades de datos con cada solicitud. Este diseño permite el acceso a datos en tiempo real y conduce a una reducción directa de la sobrecarga computacional, mejorando la eficiencia y el rendimiento de los sistemas de IA.

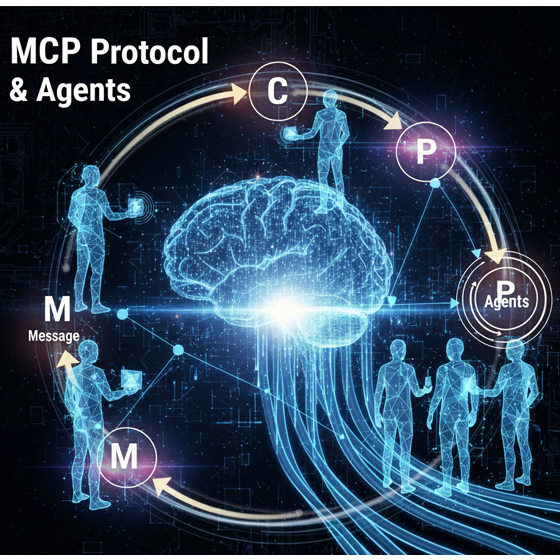

1.2. Arquitectura y Componentes Clave

La arquitectura del Protocolo de Contexto de Modelo se basa en un modelo Host-Cliente-Servidor, donde cada componente tiene una función específica y complementaria. Esta estructura modular es la clave para su escalabilidad, seguridad y eficiencia.

- Host MCP: Es la aplicación central que alberga la inteligencia de la IA. Un Host puede ser un asistente de chat, un asistente de código integrado en un IDE, o cualquier otra herramienta impulsada por IA que necesite acceso a datos externos. El Host actúa como el coordinador principal, creando y gestionando múltiples instancias de clientes y controlando sus permisos de conexión y su ciclo de vida.

- Cliente MCP: Este componente reside dentro del Host y actúa como intermediario. El Cliente es responsable de implementar el protocolo MCP y de gestionar la conexión y la comunicación con el Servidor MCP. Mantiene una conexión de sesión aislada con cada servidor y es el encargado de enviar solicitudes de herramientas y recibir las respuestas.

- Servidor MCP: Sirve como un puente entre el Cliente y las fuentes de datos externas. Los servidores MCP pueden conectarse a una variedad de fuentes, como bases de datos (SQL, NoSQL), APIs (REST, GraphQL), o archivos y repositorios de código locales. La función principal del servidor es exponer herramientas, recursos y prompts que el agente de IA puede utilizar.

El flujo de interacción dentro de esta arquitectura es un proceso dinámico. Por ejemplo, en un asistente de chat impulsado por IA, si un usuario pregunta por el pronóstico del tiempo:

- El Host envía la consulta del usuario, junto con una lista de herramientas disponibles proporcionadas por el Servidor, a un LLM.

- El LLM procesa la solicitud y determina que la herramienta de la API del clima es la más adecuada para la tarea.

- El Cliente realiza una llamada estructurada al Servidor MCP para obtener los datos del clima.

- El Servidor ejecuta la consulta, recupera la información de la API externa y devuelve la respuesta.

- Finalmente, el Host compila el resultado y lo presenta al usuario.

Esta división de responsabilidades entre el Host, el Cliente y el Servidor es un patrón de diseño que va más allá de la mera organización. Constituye un pilar arquitectónico para la seguridad y la escalabilidad en sistemas complejos. El Host puede aplicar políticas de seguridad y control de acceso a nivel de usuario antes de que una solicitud se envíe a los servidores. Los servidores, por su parte, pueden ser altamente especializados en tareas específicas, como la gestión de datos financieros o el acceso a un sistema CRM, lo que simplifica su desarrollo y mantenimiento. Este enfoque modular permite que las funcionalidades se escalen de forma independiente sin requerir una reestructuración de la aplicación completa, lo que reduce la fragilidad del sistema y fomenta una expansión ordenada.

1.3. Mecanismos de Comunicación

El protocolo MCP define un conjunto claro de reglas para la comunicación entre sus componentes. Se basa en JSON-RPC 2.0 y define tres tipos de mensajes principales: Requests, Responses (para resultados exitosos o errores) y Notifications (mensajes unidireccionales que no esperan una respuesta). La comunicación es inherentemente bidireccional, lo que permite un flujo de información eficiente.

El ciclo de vida de una conexión MCP se divide en tres fases distintas: Initiation, donde el cliente y el servidor acuerdan las versiones del protocolo; Message Exchange, la fase de comunicación normal donde se intercambian solicitudes y respuestas; y Finalization, donde la conexión se cierra de forma ordenada.

Un aspecto importante es que, si bien el protocolo define la estructura de la comunicación, no incluye nativamente mecanismos de seguridad como la autenticación, la autorización o el cifrado. El MCP puede operar sobre HTTP, lo que lo hace susceptible a ataques si no se implementa Transport Layer Security (TLS) de forma proactiva. La responsabilidad de garantizar la seguridad, como la validación de la entrada de datos, la limitación de la velocidad de las solicitudes y la protección de los datos sensibles, recae en el desarrollador y se aplica en el nivel del Host o del Servidor.

2. Impacto de MCP en la Inteligencia Artificial y Agentes de IA

2.1. Habilitación de la IA Agéntica

El auge del MCP está intrínsecamente ligado al concepto de la IA Agéntica. Los agentes de IA son programas inteligentes basados en LLMs que pueden perseguir objetivos y actuar de forma autónoma en nombre de los usuarios. El MCP es el principal medio para que estos agentes superen las limitaciones de los datos con los que fueron entrenados. Al conectar a los agentes con el «mundo exterior» —es decir, con herramientas externas y fuentes de datos en tiempo real— el MCP les permite incorporar nueva información en su proceso de toma de decisiones y en la generación de contenido. Esto es crucial para tareas que requieren datos actualizados, como hacer una reservación o buscar información reciente en la web.

El protocolo proporciona las capacidades clave que son fundamentales para un comportamiento agéntico sofisticado. El MCP permite a los agentes utilizar un «interfaz de uso de herramientas» (tool use interface) que les permite invocar funciones estructuradas. También facilita la «gestión de la memoria» (memory management) para que los agentes puedan mantener un estado contextual y recordar acciones o hechos pasados. Además, permite la «gestión de objetivos» (goal management), permitiendo a los agentes rastrear planes y el progreso de las tareas, e incluso soportar un «bucle de reflexión» (reflection loop) para auto-evaluar y revisar sus estrategias.

2.2. Gestión de Contexto y Estado

Una de las contribuciones más importantes del MCP es su capacidad para gestionar el contexto y el estado a lo largo de las interacciones. A diferencia de las peticiones tradicionales que son «sin estado», el MCP permite a los agentes mantener la continuidad a través de las sesiones. Esto lo hace ideal para aplicaciones que requieren un estado persistente, como asistentes de código que operan a lo largo de múltiples sesiones, agentes de investigación autónomos, o copilotos internos que necesitan recordar la historia de una conversación.

El MCP transforma el contexto de un elemento pasivo a uno activo. Mientras que los métodos tradicionales a menudo requerían que un desarrollador pre-cargara el contexto para el modelo (por ejemplo, en el prompt inicial), el contexto en un sistema MCP es dinámico y se genera bajo demanda. El LLM no solo recibe el contexto, sino que también tiene la capacidad de solicitarlo activamente a través de una herramienta expuesta por un servidor. Esta capacidad para obtener información específica en tiempo real reduce la sobrecarga computacional del pre-procesamiento y permite una mayor adaptabilidad del agente a las necesidades cambiantes del usuario.

2.3. Comparación con Otros Protocolos Agénticos

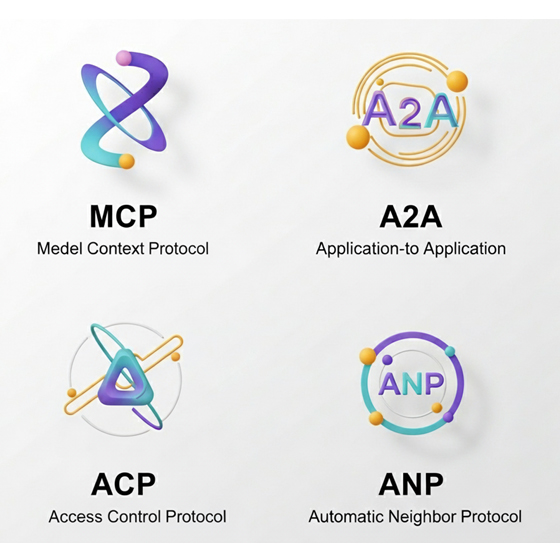

Para comprender plenamente el papel del MCP en el ecosistema de la IA, es esencial distinguirlo de otros protocolos de agentes. A diferencia de otros estándares, el MCP no es un protocolo de «comunicación entre agentes» (agent-to-agent chat), sino más bien un «adaptador universal de herramientas» para que un único agente pueda interactuar con el mundo externo.

Existen otros protocolos con diferentes propósitos:

- FIPA-ACL y KQML: Estos protocolos, que datan de la década de 1990, se basan en la teoría de los actos de habla y se centran en la comunicación formal entre agentes. Utilizan verbos de acción como

informar,consultaryproponer. - A2A (Agent-to-Agent): Está diseñado para permitir que equipos de agentes se comuniquen, coordinen y colaboren entre sí.

- ACP (Agent Communication Protocol): Moderniza los protocolos de la era de FIPA-ACL para entornos empresariales, enfocándose en la interoperabilidad entre agentes construidos con diferentes marcos.

- ANP (Agent Network Protocol): Se concentra en la resiliencia y el descubrimiento dinámico en redes de agentes, permitiendo que nuevos agentes se unan o salgan dinámicamente.

El análisis de estos protocolos muestra que no son competidores directos, sino que representan «capas complementarias de una nueva pila de comunicación». Un agente podría usar el MCP para acceder a sus herramientas, el A2A para colaborar con su equipo y el ANP para descubrir nuevos socios en la red abierta. Este enfoque modular reconoce la necesidad de un ecosistema especializado de protocolos para abordar los distintos aspectos de la autonomía y la interacción en la IA.

A continuación, la Tabla 1 ilustra estas diferencias.

Tabla 1: Comparación de Protocolos de Agentes de IA

| Protocolo (Enfoque) | Características Claves |

| MCP Adaptador de herramientas para un único agente | Uso de herramientas, gestión de memoria, estado de sesión persistente. Casos de uso: Asistentes de código, agentes de investigación, chatbots con acceso a bases de datos |

| FIPA-ACL/KQML Comunicación formal entre agentes | Mensajería basada en actos de habla, patrones de conversación estructurados. Casos de uso: Sistemas multi-agente para subastas, negociación o planificación |

| A2A Colaboración en equipo entre agentes | Coordinación de tareas, intercambio de mensajes estructurados para objetivos compartidos. Caso de uso: Equipos de agentes que trabajan juntos en un proyecto de software |

| ACP Interoperabilidad de agentes en la empresa | Modernización de FIPA-ACL para entornos empresariales, enfoques basados en REST. Caso de uso: Agentes de diferentes departamentos colaborando en una empresa |

| ANP Redes de agentes dinámicas y resilientes | Descubrimiento dinámico, tolerancia a fallos, capas de confianza. Caso de uso: Redes abiertas de agentes donde la resiliencia y la escalabilidad son clave |

3. Uso y Aplicaciones para Desarrolladores Backend

3.1. Simplificación de la Integración y Reducción de Costos

Para los desarrolladores de backend, el MCP ofrece beneficios significativos al estandarizar la forma en que se construyen y se exponen las funcionalidades. Al proporcionar un «conjunto consistente y claro de reglas» , el protocolo elimina la necesidad de desarrollar y mantener conectores personalizados para cada plataforma externa, lo que reduce la complejidad y los dolores de cabeza de mantenimiento.

Este enfoque no solo simplifica el flujo de trabajo de desarrollo, sino que también tiene un impacto financiero tangible. El uso del MCP puede reducir la sobrecarga de desarrollo y los costos de mantenimiento hasta en un 30%. Esta reducción de costos es una consecuencia directa de la estandarización. Sin el MCP, una empresa que desarrolla 50 herramientas para sus agentes de IA tendría que gestionar y actualizar 50 integraciones API únicas. Con el MCP, la empresa gestiona un solo protocolo, lo que hace que el escalado de funcionalidades sea mucho más sencillo y menos costoso de mantener a largo plazo.

3.2. Modelos de Desarrollo: Consumir vs. Construir

El MCP ofrece a los desarrolladores de backend dos modelos de implementación principales, que se adaptan a diferentes necesidades y niveles de experiencia.

- Consumir servidores existentes: La mayoría de los desarrolladores optarán por este camino. Implica construir la funcionalidad agéntica de una aplicación consumiendo las herramientas y capacidades ya disponibles en servidores MCP preexistentes, como el Azure MCP Server. Este enfoque permite una rápida adición de capacidades de IA sin la complejidad de construir un servidor desde cero.

- Desarrollar sus propios servidores: Para necesidades específicas que requieren herramientas internas o personalizadas (por ejemplo, un sistema de inventario o un acceso a una base de datos propietaria), los desarrolladores pueden crear sus propios servidores MCP. Este modelo ofrece control total sobre las herramientas, los recursos y los prompts expuestos y se puede implementar utilizando una variedad de lenguajes y marcos de trabajo, como Python o TypeScript.

Este modelo de desarrollo de dos niveles es una estrategia fundamental para fomentar la adopción. Se baja la barrera de entrada para la mayoría de los desarrolladores, permitiendo que la IA agéntica se generalice rápidamente, mientras que se ofrece la flexibilidad necesaria para aplicaciones empresariales o de nicho que requieren una personalización profunda.

3.3. Comparación con Protocolos Tradicionales (REST, GraphQL, gRPC)

El MCP no es un reemplazo de los protocolos web tradicionales, sino una capa de aplicación especializada que se construye sobre ellos. Su diseño y filosofía lo diferencian de REST, GraphQL y gRPC.

- MCP vs. REST y GraphQL: A diferencia de REST, que se basa en interacciones «sin estado» orientadas a recursos, o de GraphQL, que se centra en la flexibilidad de la consulta, el MCP se concentra en la gestión de un contexto compartido y evolutivo a lo largo de múltiples interacciones. Para un agente de IA que necesita mantener el estado de una conversación o de un plan a lo largo del tiempo, esta capacidad es crucial. Por ejemplo, una API REST para un carrito de compras requeriría que el cliente reenviara IDs de usuario y productos en cada solicitud, mientras que un agente de IA que use MCP podría simplemente rastrear el estado del carrito en el lado del servidor, actualizándolo incrementalmente.

- MCP vs. gRPC: gRPC es un protocolo de RPC (llamada a procedimiento remoto) de alto rendimiento con contratos de servicio estrictos. Si bien es excelente para la comunicación de baja latencia entre microservicios, no gestiona intrínsecamente el contexto más allá de las llamadas individuales. Curiosamente, la comunidad ha debatido la posibilidad de que el MCP adopte gRPC como una capa de transporte subyacente debido a sus ventajas, como el soporte para mensajes fuertemente tipados, HTTP/2 y características de seguridad modernas.

En esencia, el MCP opera en una capa de abstracción superior, añadiendo una lógica de negocio y una gestión de estado que son únicas para las interacciones de los agentes de IA. Las tablas a continuación demuestran las diferencias y beneficios clave del MCP.

Tabla 2: MCP vs. Protocolos Web Tradicionales (REST, GraphQL, gRPC)

| Protocolo (Filosofía Principal) | Uso Típico |

| MCP Contexto y funcionalidad | Conexión de LLMs a herramientas. Mantiene y evoluciona el contexto compartido en sesiones largas |

| REST Recursos y acciones (CRUD) | APIs de servicios web y móviles Simplicidad y uso de estándares HTTP |

| GraphQL Consulta de datos flexibles | APIs para evitar sobre-fetching de datos. Permite a los clientes solicitar estructuras de datos específicas |

| gRPC Llamadas de procedimiento remoto | Microservicios de alto rendimiento. Comunicación de baja latencia y mensajes fuertemente tipados |

Tabla 3: Beneficios Clave del Protocolo MCP

| Beneficio | Descripción |

| Acceso a Datos en Tiempo Real | Permite a los sistemas de IA trabajar con información actualizada al recuperar datos solo cuando es necesario, sin depender de conjuntos de datos pre-indexados. |

| Mayor Seguridad y Cumplimiento | Minimiza la exposición de datos sensibles al evitar el almacenamiento de copias innecesarias y al usar un modelo seguro de solicitud bajo demanda. |

| Menor Sobrecarga Computacional | Reduce la necesidad de pre-procesamiento intensivo y bases de datos vectoriales, ya que los modelos solicitan solo la información necesaria en tiempo real. |

| Escalabilidad sin Esfuerzo Adicional | El estándar unificado elimina la necesidad de crear conectores personalizados para cada plataforma, lo que simplifica la expansión de funcionalidades en múltiples flujos de trabajo de IA. |

| Simplificación del Desarrollo y Mantenimiento | Los desarrolladores ya no necesitan mantener múltiples conectores de API, lo que acelera el desarrollo y reduce los dolores de cabeza de mantenimiento. |

| Mayor Adaptabilidad de la IA | Ayuda a los modelos de IA a descubrir y ajustarse dinámicamente a nuevas fuentes de datos y entornos cambiantes sin una reconfiguración constante. |

4. Caso de Uso Práctico: Implementación de un Servidor MCP en Python

La implementación de un servidor MCP es un excelente ejemplo de su practicidad para los desarrolladores de backend. El proceso se simplifica enormemente gracias a bibliotecas como FastMCP y el SDK oficial de MCP para Python.

4.1. Configuración del Entorno

Para comenzar, el desarrollador debe configurar un entorno de desarrollo aislado utilizando herramientas como uv o pip para gestionar las dependencias del proyecto. Se recomienda una estructura de directorios modular para mantener el código organizado, con subdirectorios para las herramientas (/tools) y los manejadores (/handlers).

4.2. Creación de un Servidor MCP Básico con FastMCP

La biblioteca FastMCP maneja gran parte del código repetitivo del protocolo, lo que permite a los desarrolladores centrarse en la lógica de negocio. Un servidor mínimo se puede crear con solo unas pocas líneas de código:

from fastmcp import FastMCP

# Crea una instancia del servidor con un nombre descriptivo

mcp = FastMCP(name="Mi Primer Servidor MCP")

# Define y registra herramientas o recursos

#... (código de ejemplo para herramientas y recursos)

if __name__ == "__main__":

mcp.run()FastMCP abstrae la complejidad de JSON-RPC y la gestión del ciclo de vida de la conexión, permitiendo una implementación limpia y legible.

4.3. Definición y Exposición de una Herramienta (Tool)

El corazón de un servidor MCP son las «herramientas» que expone. Una herramienta es una función que un LLM puede ejecutar para realizar una acción o recuperar información. Con FastMCP, definir una herramienta es tan simple como decorar una función de Python estándar con @mcp.tool.

Consideremos una herramienta para calcular el tiempo de viaje entre dos ubicaciones:

from fastmcp import FastMCP

mcp = FastMCP(name="My First MCP Server")

@mcp.tool

def calculate_travel_time(origin: str, destination: str) -> str:

"""

Calcula el tiempo de viaje estimado entre dos ubicaciones.

"""

# Lógica de la herramienta que podría llamar a una API de mapas externa

return f"El tiempo de viaje de {origin} a {destination} es de 30 minutos."

#... (El resto del servidor)FastMCP inspecciona automáticamente los docstrings de la función y las sugerencias de tipo de Python para generar un esquema de metadatos que el servidor MCP expone al cliente. Este esquema permite que el LLM «descubra» la herramienta, entienda su propósito y sepa qué parámetros necesita para invocarla correctamente.

4.4. Interacción con un Cliente de IA

Una vez que el servidor está en funcionamiento, un cliente de IA, como una aplicación que utiliza Claude, puede interactuar con él. Cuando un usuario hace una pregunta como: «¿Cuánto se tarda de Nueva York a Boston?», el LLM recibe el esquema de la herramienta del servidor MCP. Con base en la description y el input_schema proporcionados, el LLM determina que la herramienta calculate_travel_time es la mejor opción. Luego, el agente realiza una llamada estructurada al servidor MCP, pasando los parámetros origin="Nueva York" y destination="Boston". El servidor ejecuta la función de Python y devuelve el resultado, que el agente compila y presenta al usuario.

Este proceso demuestra la capacidad del MCP para permitir una interacción dinámica y en tiempo real. Otras bibliotecas y plataformas, como el SDK de Anthropic para Python y pydantic_ai , también ofrecen funcionalidades de «llamada a funciones» que se alinean con la filosofía del MCP, validando aún más la promesa de un ecosistema de desarrollo más integrado y menos fragmentado.

5. Conclusión

El Protocolo de Contexto de Modelo (MCP) no es solo una nueva API; es una norma que resuelve la fragmentación en la integración de herramientas para la IA, sentando las bases para la creación de agentes autónomos, contextuales y escalables. Su arquitectura modular Host-Cliente-Servidor es un patrón de diseño robusto que promueve la eficiencia, la seguridad y la especialización de las funcionalidades. Al permitir a los agentes de IA acceder a datos en tiempo real y ejecutar acciones dinámicas, el MCP los libera de las limitaciones de sus datos de entrenamiento, transformándolos de simples modelos de lenguaje en motores de acción.

Si bien el MCP es prometedor, su adopción generalizada dependerá del crecimiento de un ecosistema rico de servidores de herramientas y de la madurez del protocolo mismo. La discusión en curso sobre la posible integración de tecnologías como gRPC como capa de transporte subyacente demuestra que el protocolo está en constante evolución y que el ecosistema está trabajando activamente para optimizar sus capacidades.

En retrospectiva, el MCP es más que una simple moda pasajera. Es la capa de abstracción necesaria para una nueva generación de aplicaciones de software que ya no se limitan a procesar datos, sino que actúan de forma autónoma y dinámica en el mundo real en nombre de los usuarios. Representa el comienzo de una era donde los sistemas de IA están profundamente integrados con el entorno funcional, marcando un paso decisivo en la evolución hacia la inteligencia agéntica.

————————————————————

Fuentes: